「会社の Web サイトの URL を入れるだけで、AI が FAQ を勝手に 10 個作ってくれる」── そんな世界が当たり前になりつつあります。i-Style が開発している AI FAQ チャットボット Chatta も、まさにその体験を中小企業向けに届けているプロダクトです。

一見シンプルに見えるこの体験の裏側には、プロンプト設計・RAG 検索・応答分岐・自動改善ループという 4 つのレイヤーで地道な工夫が重なっています。この記事では、Chatta が実際に採用しているアプローチを、業界の一般的な手法と比較しつつ公開します。

この記事を読むとわかること

- check_circle FAQ 自動生成でよくある「詰まりポイント」3 つ

- check_circle 業界の一般的な 3 つのアプローチと、それぞれの強み・弱み

- check_circle Chatta が採用した「プロンプト設計 5 原則」と具体的な閾値

- check_circle 応答分岐と自動改善ループで「使うほど賢くなる」を実装する考え方

FAQ 自動生成でよくある 3 つの詰まり

「Web サイトのテキストを LLM に渡して FAQ を作らせる」── 原理はシンプルですが、実務で組もうとすると次の 3 点で必ずつまずきます。

| つまずき | 症状 |

|---|---|

| ① 漠然とした質問しか出ない | 「このサービスはどんな特徴がありますか?」のような、誰も検索しない質問だけが並ぶ |

| ② 回答が一般論になる | 「弊社では高品質なサービスを〜」など、サイトに書いていない美辞麗句を AI が補って書いてしまう |

| ③ 出力形式が安定しない | Markdown で返ってきたり JSON で返ってきたり、後処理が破綻する |

この 3 つを全部プロンプトだけで潰しにいくのが、FAQ 自動生成の裏テーマです。

業界の一般的な 3 つのアプローチ

FAQ チャットボットの設計には、2026 年現在、大まかに次の 3 パターンがあります。

| アプローチ | 代表例 | 強み | 弱み |

|---|---|---|---|

| A. マルチデータ統合型 | 国内の AI チャットボット専業ベンダー | メール履歴・通話ログ・マニュアルを混合学習 | 導入に大量のデータと工数が必要 |

| B. 独自検索モデル型 | 海外の大規模カスタマーサポート AI | 専用の検索モデルで高い正答率(90% 近い自動解決) | 大企業向け価格帯、小規模には過剰 |

| C. 汎用 LLM + RAG 型 | Chatta を含む多数の新興 SaaS | 導入がシンプル、プロンプトで差別化しやすい | プロンプト設計の質がそのまま製品力になる |

C タイプ(汎用 LLM + RAG)は、一見「LLM を呼ぶだけ」に見えて、実はプロンプトとパイプラインの設計差が最終品質を決めます。ここをどう作るかが勝負どころです。

Chatta の前提 ──「IT に詳しくない経営者が、5 分で使える」

設計判断の出発点は、ターゲット読者の解像度です。Chatta の想定ユーザーは「IT リテラシーが低い中小企業の社長」。その前提があるからこそ、入り口のシンプルさが機能に勝ります。

Chatta の設計思想

社長がやるのは「URL を入力する」「承認ボタンを押す」「たまにメールを見る」だけ。データ連携、プロンプト編集、モデル選定といった専門知識を前提にしない。その代わり、裏側のプロンプトとパイプラインで品質を担保する。

Chatta の FAQ 生成プロンプト 5 原則

Chatta の FAQ 自動生成プロンプトは、全体で約 60 行。その骨格は次の 5 つの原則で構成されています(プロンプト全文ではなく、設計の考え方を公開します)。

| # | 原則 | 狙い |

|---|---|---|

| 1 | ライター人格を先に与える | 「あなたはプロの FAQ ライターです」と冒頭で役割を固定し、トーンと視点のブレを防ぐ |

| 2 | ルールを階層化して書く | 「質問文ルール」「回答文ルール」「カテゴリ分けルール」を節で分ける。LLM が参照しやすくなる |

| 3 | 悪い例と良い例を対で示す | 抽象ルールだけだと LLM は従いきれない。NG/OK を具体文で 3 対ずつ並べる |

| 4 | 優先度の序列を明示する | 料金 → 申込方法 → サービス内容 → 対象条件… と上位 7 項目を番号付きで指定。生成内容の偏りを制御する |

| 5 | 出力を JSON に固定する | Markdown や箇条書きで返されると後処理が破綻する。JSON 配列強制で「必ずパース可能」を担保 |

原則 3(悪い例と良い例)の実例

実際のプロンプトに含まれている NG / OK 例の一部を抜粋します。この対比が、LLM の出力品質を大きく引き上げるレバーになります。

| ❌ 悪い例 | ✅ 良い例 |

|---|---|

| Q: このサイトはどんなサイトですか? (漠然としすぎ) |

Q: 初期費用はかかりますか? A: 初期費用は無料です。月額プランは 3,980 円からご利用いただけます。 |

| A: 詳しくはお問い合わせください。 (回答になっていない) |

Q: 無料体験はありますか? A: はい、14 日間の無料トライアルをご用意しています。クレジットカードの登録は不要です。 |

| A: 弊社では高品質なサービスを提供しています。 (具体性がない/サイトに書いていない) |

Q: 退会したい場合は? A: マイページの「アカウント設定」から退会手続きが可能です。 |

この「❌ と ✅ を対で見せる」パターンは、2026 年現在の N-shot prompting ベストプラクティスにも整合します。抽象的な「良い FAQ を作れ」では AI は動きませんが、具体の反証例を並べることで LLM の出力分布は劇的に引き締まります。

実運用で使っているパラメータ

プロンプトと合わせて、以下のパラメータも公開します。全て Chatta の本番で実際に使っている数値です。

| パラメータ | 値 | 意図 |

|---|---|---|

| 投入テキスト上限 | 50,000 文字 | トークン予算と精度のバランス点 |

| 生成 FAQ 数 | 10〜15 個(最低 8) | 導入初日から実用的な密度を担保 |

| RAG 類似度閾値 | 0.45 | 業界推奨 0.7〜0.8 より低め。FAQ が少ない初期でもヒットさせるため |

| 聞き返し判定のスコア差 | 0.03 未満 | 上位 3 件のスコアが僅差なら「どれを聞きたい?」と確認する |

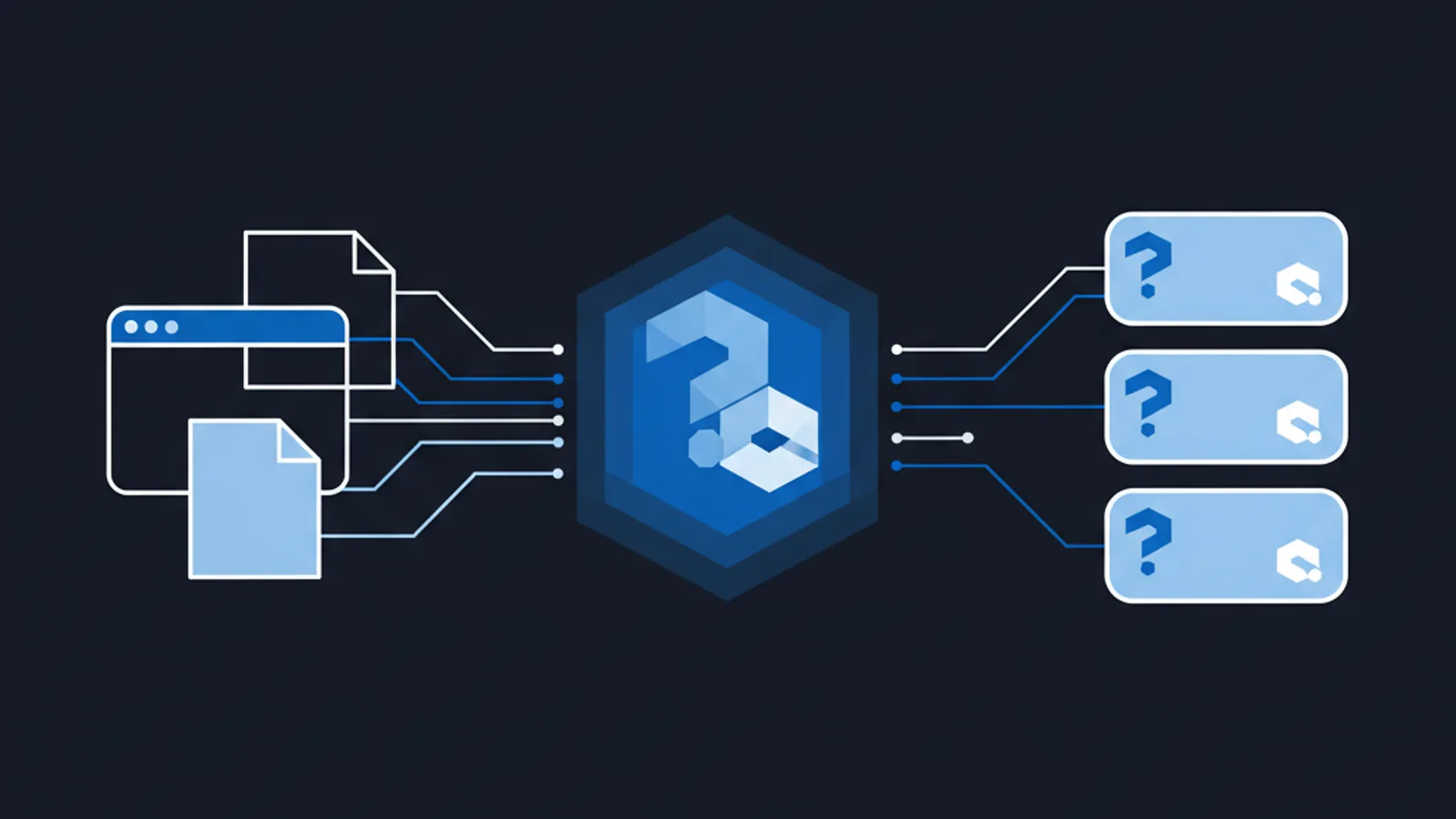

応答分岐の全体フロー

ユーザーの質問を受けてから、Chatta は 1 秒前後で以下のフローを走ります。

ポイントは、「分からない時は頑張って答えるのではなく、聞き返す」という設計にあります。低信頼の推測で答えてしまうより、ユーザーに選んでもらった方が、最終的な満足度は上がります。

「使うほど賢くなる」自動改善ループ

FAQ は作って終わりではありません。公開後に必ず「答えられなかった質問」「評価が低かった回答」が出ます。ここを人手でメンテするか、AI に任せるかで、運用負荷が大きく変わります。

Chatta は、以下の 3 つの「改善の芽」を AI が自動で拾い、管理者には承認ボタンだけを求める設計にしています。

- check_circle 未回答質問の自動 FAQ 化 ── ボットが答えられなかった質問を集計し、類似するものをまとめて AI が FAQ 案を作る

- check_circle 低評価 FAQ の改善提案 ── 「役に立たなかった」が続く FAQ を AI が再生成

- check_circle 有人回答の FAQ 化 ── エスカレーションで担当者が答えた内容を AI が FAQ 形式に整形

業界との差分

多くの既存プラットフォームでは、「答えられなかった質問」を人間が分析して FAQ を足す運用が標準です。Chatta はこの部分を AI に寄せ、人間は承認するだけにすることで、IT 専任者がいない中小企業でも運用が回る設計を目指しています。

まとめ ── プロンプトはプロダクト設計そのもの

FAQ 自動生成は、LLM に投げれば終わる仕事ではありません。誰に使わせるかを先に決めて、そこから逆算してプロンプトのルール構造、RAG の閾値、応答分岐、自動改善までを一貫した思想で設計する必要があります。

Chatta の場合、「IT に詳しくない中小企業の社長が、5 分で使い始められる」という 1 行から全ての設計が派生しています。プロンプト 60 行、パラメータ 4 つ、閾値 3 段、自動改善 3 種 ── 一見ばらばらに見える要素が、同じ思想に貫かれているか。それが、プロダクトが「使える」か「使われない」かの分水嶺です。

Chatta を試してみる

この記事で紹介した仕組みは、実際に Chatta で動いています。Web サイトの URL を入れるだけで FAQ が自動生成される体験、ぜひご自身の手で試してみてください。

Chatta を見る arrow_forward